AI(人工知能)の世界最高峰の国際会議 「NeurIPS 2022」で論文採択

〜Vision Transformerに代わる画像認識モデル〜

2022年9月27日

立教大学

報道関係各位

立教大学大学院人工知能科学研究科(所在地:東京都豊島区、研究科委員長:内山 泰伸)の博士後期課程1年次の立浪 祐貴 さん(AnyTech株式会社 勤務)と瀧 雅人 准教授の研究成果が、機械学習分野の国際会議の一つである「NeurIPS 2022 」(Neural Infomation Proccessing Systems)に採択されたことをお知らせいたします。

「NeurIPS」は毎年開催される機械学習分野の国際会議で、機械学習・深層学習・強化学習・学習理論等の分野において、世界最高峰と目される会議です。今年は10,411件の投稿の中から、25.6%の論文が採択されています。採択された論文は、2022年11月28日から12月9日まで米国ルイジアナ州ニューオリンズで開催される「NeurIPS 2022」にて発表を行います。

本研究では、先端的なコンピュータビジョンにおいて用いられるTransformerのアテンション機構が、古典的なリカレントニューラルネットで代用可能であることが明らかにされました。さらにこの発見に基づき、畳み込みもアテンション機構も用いない新たな画像認識モデル、Sequencerを提案しました。Sequencerは、純国産の画像認識モデルとしては初めてPytorch Image Modelsに採用されました。

【画像:https://kyodonewsprwire.jp/img/202209267134-O1-Y6b6xInB】

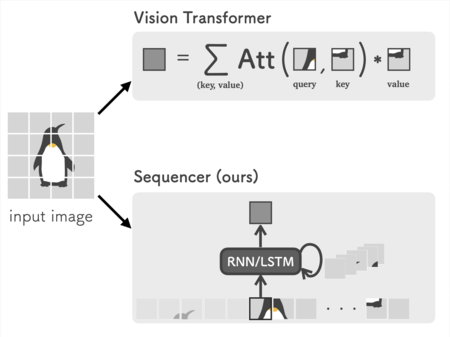

画像認識のための二つのアプローチの模式図。

上図:アテンション機構を使って、画像のパッチを大域的に相互作用させる。

下図:リカレントニューラルネットを使って、逐次的に画像のパッチの情報を集約する。

研究背景

深層学習が幅広いタスクにおいて極めて高い性能を達成できる理由の一つは、ネットワーク構造のデザインの柔軟性にあると言われています。つまり良いネットワーク構造は、課題タスクに関する事前知識(以下、帰納バイアス)をうまく反映し、その構造を通じて学習を手助けするヒントが与えられるのです。

例えばコンピュータビジョンにおいては、2012年頃の深層学習のブレイクスルー以来、畳み込みニューラルネット(以下、CNN)が帰納バイアスのデファクトスタンダードでした。CNNがコンピュータビジョンの強力な手法であるという認識は、1970年代の福島 邦彦 氏によるネオコグニトロンの発見以来のものです。

ところが2020年、コンピュータビジョンにおいて劇的な発見がなされました: アテンション機構から成るVision Transformerと呼ばれるネットワークを用いると、さまざまなコンピュータビジョンタスクにおいてCNNを上回る性能を達成できることが判明したのです。アテンション機構は元々、自然言語処理の研究において発見された帰納バイアスです。近年の機械翻訳、言語生成、テキストからの画像生成などの華々しい成果は、どれもアテンション機構を用いて実現されています。このような強力な仕組みがコンピュータビジョンでも有用であることが分かってきたため、今後コンピュータビジョンにおいても、デファクトスタンダードの地位がCNNからアテンション機構へと移り変わっていくと、多くの専門家が考えています。

研究成果

本研究では、コンピュータビジョンにおいてはアテンション機構をよりシンプルな帰納バイアスに置き換えられることを発見し、新たな画像認識モデルSequencerを提案しました。Sequencerは、他の先端的な手法と競争的な精度を達成する画像認識モデルです。

2020年頃より、アテンション機構はコンピュータビジョンにおいて重要な地位を占めるようになりました。ところがその一方で、2021年にはアテンション機構の重要性に疑問を投げかけるような研究結果も現れ始めています。 そのため現在、コンピュータビジョンモデルにおいてアテンション機構がどのような役割を果たしているのか、そもそも必要な機構なのかという問が、重要な研究テーマとして国際的に注目されています。

このような背景のもと、本研究ではアテンション機構をリカレントニューラルネット(以下、RNN)という古典的な機構で置き換えると、モデルの画像認識精度が向上することを発見しました。アテンション機構のような複雑な仕組みを使わずとも、数十年前から知られているRNNによってその肩代わりができるのです。この結果は、アテンション機構は必ずしも必要ではないことを意味し、その役割を考え直す必要を迫るものです。

そればかりか、提案モデルであるSequencerは先端的なCNNの性能も凌駕します。つまりRNNは、画像認識に適した帰納バイアスであることが判明したのです。本来RNNは時系列処理のために開発された手法です。そのためRNNによって先端的な画像認識性能が達成できることは、これまで全く気づかれていませんでした。この結果は、今後のコンピュータビジョンモデルの設計指針に対し、新たなアプローチを提供する可能性があります。

今後の期待と課題

SequencerはCNNやVision Transformerに比べて、処理速度が遅い問題があります。その実用性向上のため、処理速度の改善が今後の重要な課題です。また、これまでCNNやアテンション機構が用いられてきた応用的なコンピュータビジョンのタスクにおいて、Sequencerが適用されると期待できます。それだけでなく、アテンション機構に思わぬ比較対象が出現したことで、アテンション機構のより深い理解につながる研究の契機となることも期待されます。

キーワード

・NeurIPS(Neural Infomation Proccessing Systems):機械学習と計算神経科学に関するトップレベルの国際会議。

・ コンピュータビジョン:コンピュータに画像の認識や処理を行わせる分野。

・ アテンション機構:人が重要な情報だけに注意(アテンション)を向けるように、深層学習モデルが重要な情報を自身で判断して、そこに注意を集中させる仕組み。

・ Transformer:アテンション機構を使って作られた深層学習モデル。主に、機械翻訳のような自然言語の処理に用いられる。

・ Vision Transformer:画像認識を行うために改良されたTransformer。

・ 帰納バイアス:アルゴリズム自体など、データ以外の経路を通じて、機械学習モデルが得る学習に役立つヒント。

・ 畳み込み:局所的な情報を集約することで、画像などから情報抽出をする手法。一種のフィルタリング。

・ 畳み込みニューラルネット:畳み込みを使った画像に特化したニューラルネット。

・ リカレントニューラルネット:時系列データを順次処理することで、時間軸にわたるデータの関連性を学習できるニューラルネット。

・ Pytorch Image Models:学術界・産業界問わず、最も広く使われている、最先端の画像分類ライブラリの一つ。

論文情報

・ 論文タイトル

Sequencer: Deep LSTM for Image Classification

・ 著者

Yuki Tatsunami, Masato Taki

・ 論文リンク

https://arxiv.org/abs/2205.01972